Este artículo fue actualizado por última vez el noviembre 1, 2023

Table of Contents

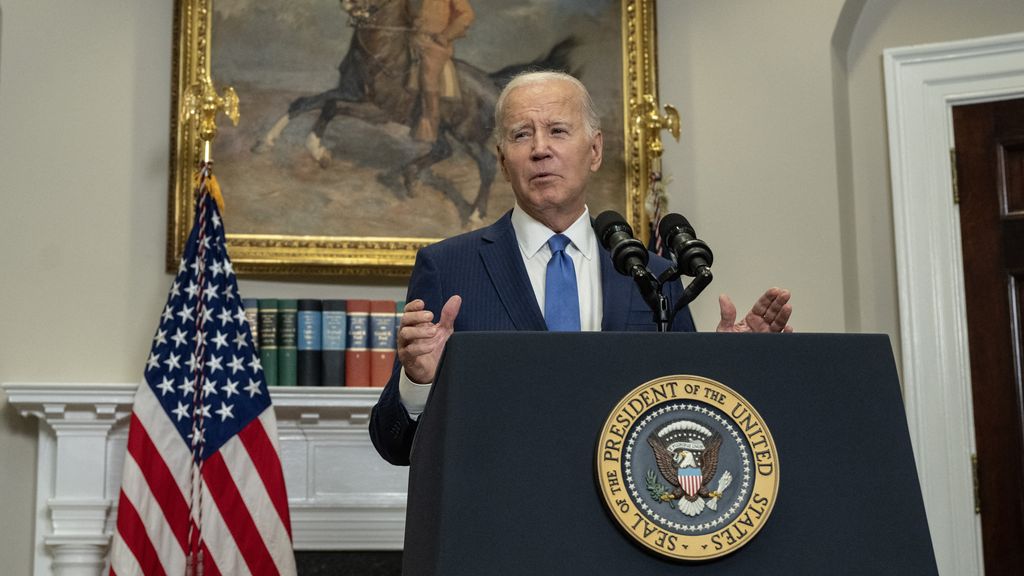

El presidente Biden toma medidas sobre las medidas de seguridad de la IA

Los fabricantes de los “sistemas de inteligencia artificial más poderosos” de EE. UU. deben compartir pruebas de seguridad y otra “información crítica” con el gobierno. Así se desprende de un decreto presidencial emitido hoy por el presidente estadounidense Biden.

El decreto de Biden forma parte de una serie de medidas con las que el gobierno estadounidense intenta conseguir un mayor control sobre la IA (inteligencia artificial). Se trata específicamente de empresas que desarrollan un sistema de inteligencia artificial que representa un “riesgo grave” para la seguridad de Estados Unidos. No se describe qué tipo de riesgo implica esto. Además, no se indica quién determina cuándo existe tal riesgo.

Un decreto presidencial no es una ley. El presidente necesita al Congreso para eso. Por lo tanto, Biden pide a los parlamentarios que presenten legislación.

IA de próxima generación

Un funcionario gubernamental anónimo subraya al Financial Times que el decreto se aplicará principalmente a la próxima generación de sistemas de inteligencia artificial y no, por ejemplo, a GPT4, el motor detrás de la última versión del generador de texto avanzado ChatGPT.

Aunque los acontecimientos avanzan rápidamente, la pregunta es cuándo las empresas tendrán que lidiar con estas reglas en la práctica y esto sugiere que Estados Unidos no quiere ser demasiado duro con sus propias empresas con estas nuevas reglas.

La Casa Blanca y los gigantes tecnológicos llevan algún tiempo debatiendo sobre la IA. En julio, los principales actores de la IA firmaron acuerdos no vinculantes. Esto también incluía la promesa de que compartirían información sobre la seguridad y confiabilidad de sus sistemas. Con la decisión de Biden esa falta de obligación desaparece.

Marca de agua para trabajos generados por IA

Además de los requisitos para las grandes empresas tecnológicas, también se trata de desarrollar una marca de agua para que quede claro cuándo el trabajo ha sido generado por IA. Aquí hay una limitación: esto solo será utilizado por los gobiernos federales, pero las empresas no tienen que adoptarlo. Aunque la Casa Blanca espera ser un ejemplo para empresas y gobiernos de todo el mundo.

También incluye medidas para proteger la privacidad de los estadounidenses, promover la igualdad, proteger los derechos de los consumidores, pacientes y estudiantes, así como de los empleados, entre otras cosas. La orden también garantiza que el propio gobierno de EE. UU. utilice la IA de manera responsable y eficaz.

Las medidas de la administración Biden se producen el mismo día que un código de conducta voluntario para la IA iniciado por los países del G7 y la UE, informó ayer Reuters. Esto establece cómo los principales países quieren abordar la IA, en el contexto de preocupaciones sobre la privacidad y la seguridad.

Cumbre de IA Reino Unido

El miércoles comenzará una reunión de AI de dos días de duración en el Reino Unido, donde su seguridad será fundamental. El vicepresidente Harris está presente en representación de Estados Unidos. En nombre de la UE se espera que el presidente de la Comisión, Von der Leyen, y el secretario de Estado, Van Huffelen, representen a los Países Bajos. También se espera una delegación de China.

Medidas de seguridad de la IA

Be the first to comment